Trump yönetimi, Amerika Birleşik Devletleri’nde yapay zeka için tek tip bir yasal çerçeve açıkladı. Bu Trump yapay zeka planı, federal otoriteyi güçlendirerek eyalet yasalarını geçersiz kılmayı hedefliyor. Plan, eyaletlerin teknoloji kullanımını ve geliştirmesini düzenleme çabalarını zayıflatabilir.

Beyaz Saray’dan yapılan açıklamaya göre, bu çerçeve ABD genelinde tekdüze uygulanırsa başarılı olabilir. Çelişkili eyalet yasalarının Amerikan inovasyonunu ve küresel yapay zeka yarışındaki liderliği zayıflatacağı belirtildi. Plan, inovasyonu ve yapay zeka ölçeklendirmesini önceliklendiren yedi temel hedef belirliyor. Bu yaklaşım, daha sıkı eyalet düzeyindeki **yapay zeka regülasyonları** yerine merkezi bir **federal denetim** öngörüyor.

Özellikle çocuk güvenliği gibi konularda ebeveynlere önemli sorumluluklar yüklüyor. Platformların sorumluluğu için ise nispeten yumuşak, bağlayıcı olmayan beklentiler ortaya koyuyor. Örneğin, Kongre’nin yapay zeka şirketlerinden cinsel sömürü riskini azaltacak özellikler uygulamasını istemesi gerektiğini belirtiyor. Ancak, net ve uygulanabilir gereklilikler sunmuyor.

Bu çerçeve, Trump’ın federal ajanslara eyalet yapay zeka yasalarına meydan okuma talimatı veren yürütme emrinden üç ay sonra geldi. Bu emir, Ticaret Bakanlığı’na “külfetli” eyalet yapay zeka yasalarının bir listesini derlemesi için 90 gün süre vermişti. Bakanlık bu listeyi henüz yayımlamadı.

Yapay Zeka Regülasyonlarında Yeni Yaklaşım

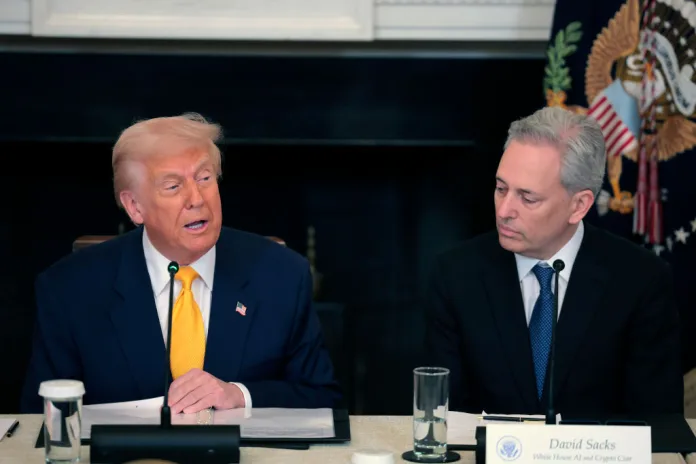

Yönetimin “inovasyonun önündeki güncel veya gereksiz engelleri kaldırma” çabasına paralel olarak, yeni çerçeve “minimum düzeyde külfetli ulusal bir standart” öneriyor. Bu, **teknoloji şirketleri** büyümesini teşvik eden, hafif dokunuşlu bir düzenleyici yaklaşım olarak dikkat çekiyor. Beyaz Saray yapay zeka sorumlusu David Sacks gibi “hızlandırıcılar” bu politikayı savunuyor.

Çerçeve, eyaletlerin dolandırıcılık, çocuk koruma, imar ve yapay zeka kullanımı gibi genel yasalarda yetkilerini koruduğunu belirtiyor. Ancak, eyaletlerin yapay zeka geliştirmeyi düzenlemesine kesinlikle karşı çıkıyor. Yapay zeka geliştirmenin “içsel olarak eyaletlerarası” bir mesele olduğunu ve ulusal güvenlik ile dış politika ile bağlantılı olduğunu savunuyor.

Ayrıca, eyaletlerin “bir üçüncü tarafın modellerini içeren yasa dışı davranışları nedeniyle yapay zeka geliştiricilerini cezalandırmasını” önlemeyi amaçlıyor. Bu, geliştiriciler için önemli bir sorumluluk kalkanı sağlıyor.

Çocuk Güvenliği ve Ebeveyn Kontrolü Vurgusu

Çerçevede, yapay zeka tarafından neden olunan potansiyel yeni zararlar için sorumluluk mekanizmaları, bağımsız denetim veya uygulama mekanizmalarına dair herhangi bir atıf bulunmuyor. Aslında, bu çerçeve yapay zeka politika yapımını Washington’da merkezileştiriyor. Eyaletlerin ortaya çıkan risklerin erken düzenleyicisi olarak hareket etme alanını daraltıyor.

- Eyaletler, ortaya çıkan riskler hakkında daha hızlı yasalar çıkarabiliyor.

- New York’un RAISE Yasası, büyük yapay zeka şirketlerinin güvenlik protokollerine uymasını hedefliyor.

- Kaliforniya’nın SB-53’ü de benzer güvenlik standartlarını zorunlu kılıyor.

The Alliance for Secure AI CEO’su Brendan Steinhauser, “Beyaz Saray yapay zeka sorumlusu David Sacks, sıradan Amerikalıların zararına Büyük Teknoloji’nin isteklerini yapmaya devam ediyor” dedi. Steinhauser, federal çerçevenin eyaletlerin yasa yapmasını engellediğini vurguladı.

Yapay zeka endüstrisindeki birçok kişi bu yönelimi kutluyor. Çünkü onlara düzenleme tehdidi olmadan “inovasyon yapma” konusunda daha geniş özgürlükler tanıyor. General Catalyst Institute Başkanı Teresa Carlson, “Bu çerçeve, startup’ların istediği şey tam da bu: Hızlı inşa edebilmeleri ve ölçeklenebilmeleri için net bir ulusal standart” dedi.

Çerçeve, çocuk güvenliğinin yapay zeka tartışmasındaki merkezi bir tartışma noktası haline geldiği bir zamanda yayımlandı. Bazı eyaletler, çocukları korumayı ve **teknoloji şirketleri**ne daha fazla sorumluluk yüklemeyi amaçlayan yasaları agresif bir şekilde geçirdi. Yönetimin önerisi ise farklı bir yönü işaret ediyor. Platform sorumluluğundan çok ebeveyn kontrolüne daha fazla vurgu yapıyor.

“Ebeveynler, çocuklarının dijital ortamını yönetmek için en donanımlı kişilerdir” şeklinde belirtiliyor çerçevede. “Yönetim, Kongre’yi ebeveynlere bunu etkili bir şekilde yapabilmeleri için araçlar vermeye çağırıyor. Örneğin, çocuklarının gizliliğini koruyacak ve cihaz kullanımlarını yönetecek hesap kontrolleri gibi.”

Çerçeve ayrıca, yönetimin yapay zeka platformlarının “çocukların cinsel sömürüsünü ve kendine zarar vermeyi teşviki azaltacak özellikler uygulaması gerektiğine” inandığını ifade ediyor. Bu tür güvenlik önlemlerini zorunlu kılmak için Kongre’yi çağırırken, “ticari olarak makul” gibi niteleyiciler kullanıyor. Net ön koşullar belirtmekten geri duruyor.

Telif hakkı konusunda ise çerçeve, yaratıcıları korumak ile yapay zeka sistemlerinin mevcut eserler üzerinde eğitilmesine izin vermek arasında orta yol bulmaya çalışıyor. “Adil kullanım” ihtiyacına atıfta bulunuyor. Bu tür bir dil, yapay zeka şirketlerinin eğitim verileri üzerindeki artan telif hakkı davaları karşısında yaptıkları argümanları yansıtıyor.

Trump’ın yapay zeka çerçevesinin ana güvenlik önlemleri, “yapay zekanın sınırlama olmaksızın gerçeği ve doğruluğu takip edebilmesini” sağlamayı içeriyor. Özellikle, platform moderasyonundan ziyade hükümet kaynaklı sansürü önlemeye odaklanıyor.

Çerçevede, “Kongre, ABD hükümetinin yapay zeka sağlayıcıları dahil teknoloji sağlayıcılarını, partizan veya ideolojik gündemlere dayalı içeriği yasaklamaya, zorlamaya veya değiştirmeye zorlamasını engellemeli” ifadesi yer alıyor. Ayrıca, Kongre’ye, yapay zeka platformlarındaki ifade özgürlüğünü sansürlemeye çalışan hükümet kurumlarına karşı Amerikalıların yasal yollara başvurabilmeleri için bir yol sağlaması talimatını veriyor.

Bu çerçeve, Anthropic’in Savunma Bakanlığı (DOD) tarafından tedarik zinciri riski olarak etiketlenmesinin ardından hükümete dava açmasıyla aynı döneme denk geliyor. Anthropic, DOD’un kendisini, askerin yapay zeka ürünlerini Amerikalıların kitlesel gözetimi veya otonom ölümcül silahlarda hedefleme ve ateşleme kararları için kullanmasına izin vermediği için misilleme olarak bu şekilde adlandırdığını savunuyor. Trump, Anthropic ve CEO’su Dario Amodei’yi “uyanık” ve “radikal solcu” olarak nitelendirmişti.

Çerçevenin “yasal siyasi ifade veya muhalefeti” korumayı vurgulayan dili, Trump’ın “uyanık yapay zeka”yı hedef alan önceki yürütme emrine dayanıyor gibi görünüyor. Bu emir, federal ajansları ideolojik olarak tarafsız kabul edilen sistemleri benimsemeye itmişti.

Sansür ile standart içerik moderasyonunun ne olduğu belirsizliğini koruyor. Bu tür bir dil, düzenleyicilerin platformlarla yanlış bilgi, seçim müdahalesi veya kamu güvenliği riskleri gibi konularda koordinasyon kurmasını zorlaştırabilir.

Demokrasi ve Teknoloji Merkezi politika başkan yardımcısı Samir Jain, “[Çerçeve] haklı olarak hükümetin yapay zeka şirketlerini ‘partizan veya ideolojik gündemlere’ dayalı içeriği yasaklamaya veya değiştirmeye zorlamaması gerektiğini söylüyor, ancak Yönetimin bu yazki ‘uyanık yapay zeka’ Yürütme Emri tam da bunu yapıyor.” dedi.