Google, yapay zeka dünyasında çığır açacak bir algoritma duyurdu. Yeni nesil bellek sıkıştırma algoritması TurboQuant tanıtıldı. Bu teknoloji, yapay zekanın çalışma belleğini küçültmenin yeni bir yolunu sunuyor. Üstelik performanstan ödün vermiyor. Büyük Dil Modelleri (LLM’ler) için yapay zeka bellek sıkıştırma kritik bir ihtiyaç haline geldi.

Büyük Dil Modellerinde KV Önbellek Darboğazı

Büyük Dil Modelleri giderek daha karmaşık görevleri üstleniyor. Devasa belgeleri işliyorlar. Uzun ve karmaşık konuşmaları analiz ediyorlar. Bu durum bağlam pencerelerinin genişlemesine yol açıyor. Modelin her işlediği kelime, yüksek hızlı bellekte depolanmak zorunda. Bu depolama yüksek boyutlu bir vektör olarak gerçekleşiyor.

Uzun süreli görevlerde bu dijital kopya kağıdı hızla büyüyor. Çıkarım sırasında kullanılan GPU’lar üzerindeki VRAM sistemi tükeniyor. Bellek kullanımının artması ciddi bir sorun teşkil ediyor. Bu nedenle model performansı zaman içinde hızla düşüyor. Bu durum, modelin verimliliğini olumsuz etkiliyor. Geliştiriciler için büyük bir optimizasyon sorunu yaratıyor.

TurboQuant: Yapay Zeka Bellek Sıkıştırmada Yeni Bir Dönem

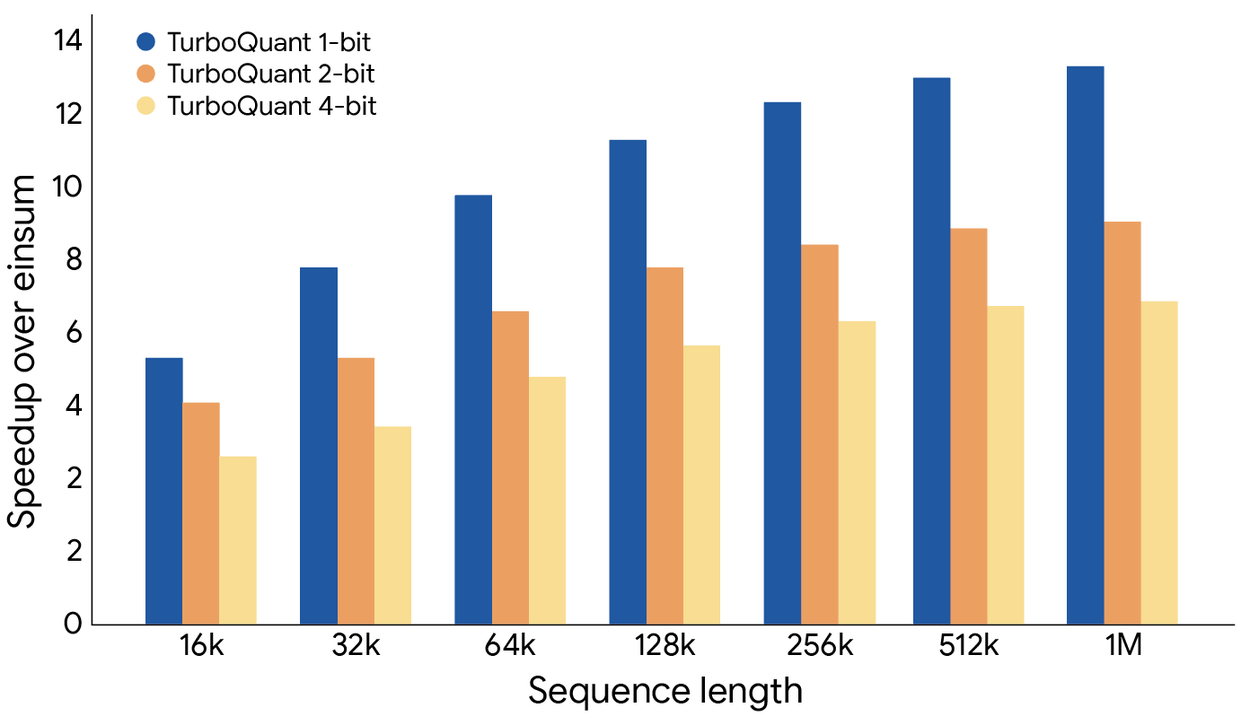

TurboQuant algoritma paketi tamamen yazılımdan oluşuyor. Aşırı KV önbellek sıkıştırması için matematiksel bir şablon sunuyor. Bu şablon, bellek kullanımını optimize etmeyi hedefliyor. TurboQuant, belirli bir modelin kullandığı KV bellek miktarını ortalama 6 kat azaltıyor. Bu, önemli bir bellek tasarrufu sağlıyor.

Ayrıca, dikkat logitlerini hesaplamada 8 kat performans artışı sağlıyor. Bu artış, modellerin daha hızlı çalışmasına olanak tanıyor. Bu algoritmayı modellerinde uygulayan işletmeler büyük fayda görecek. Tahminlere göre maliyetlerini yüzde 50’den fazla azaltabilecekler. Bu, hem enerji tüketimi hem de donanım ihtiyacı açısından büyük bir avantaj demek.

Topluluktan Hızlı Adaptasyon ve Etkileyici Sonuçlar

Google Research’ün TurboQuant duyurusu büyük ilgi gördü. Duyuru, 7,7 milyondan fazla görüntüleme aldı. Yayınlanmasından sonraki 24 saat içinde topluluk harekete geçti. Algoritmayı popüler yapay zeka kütüphanelerine taşımaya başladı. Apple Silicon için MLX ve llama.cpp gibi kütüphaneler hızla entegrasyonu sağladı.

Teknik analist Prince Canuma X’te önemli bir paylaşım yaptı. Qwen3.5-35B modelini test etmek için TurboQuant’ı uyguladı. MLX üzerinde yapılan testlerde etkileyici sonuçlar elde etti. Canuma, 8.5K ile 64K token arasında değişen bağlam uzunluklarında çalıştığını belirtti. Her nicelleme düzeyinde yüzde 100 tam eşleşme gözlemlediğini açıkladı.

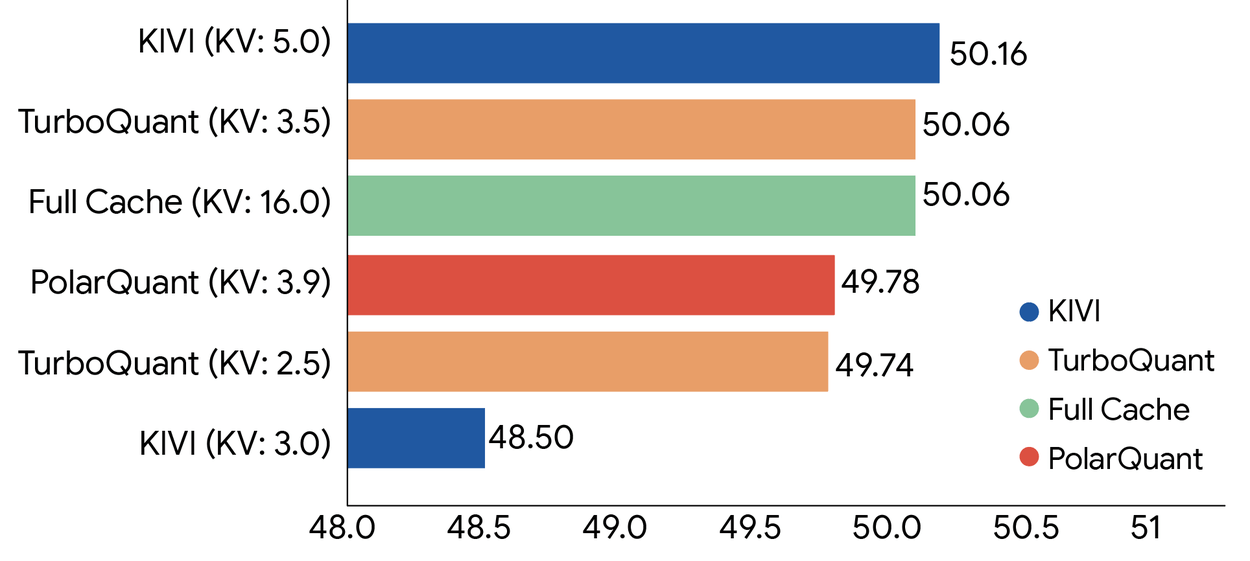

Canuma’nın testlerine göre, 2.5 bitlik TurboQuant neredeyse 5 kat azalma sağladı. KV önbelleğinde bu azalma gerçekleşti. En önemlisi, bu azalma doğruluk kaybı olmadan sağlandı. Bu, TurboQuant’ın pratik faydalarını somut bir şekilde gösteriyor. Algoritmanın güvenilirliğini ve verimliliğini kanıtlıyor.

TurboQuant’ın Gelişim Süreci ve Teknik Temelleri

Google araştırmacıları TurboQuant’ı yıllarca süren bir sürecin sonunda geliştirdi. Araştırmalar 2024’te başladı. Bu titiz süreç algoritmanın sağlam temellerini oluşturdu. Google araştırmacıları, 2025 başlarında önemli makaleler yayımladı. PolarQuant ve Quantized Johnson-Lindenstrauss (QJL) gibi temel matematiksel framework’leri ele aldılar.

TurboQuant, bu temel teorilerden faydalanıyor. Halüsinasyonlara neden olan nicelleştirme hatalarını aşmak için tasarlandı. Bu sayede modelin doğruluğu ve güvenilirliği artırılıyor. TurboQuant’ın resmi tanıtımı büyük bir dönüm noktası. Akademik olarak sunulan teorilerden büyük ölçekli üretime geçişi işaret ediyor. Bu, yapay zeka teknolojisinin olgunlaştığının bir göstergesi.

Geniş Kullanım Alanları ve Erişilebilirlik

Teorik temelli algoritmalar ve ilgili araştırma makaleleri artık ücretsiz. Kullanıcılara açık durumda. Hatta kurumsal kullanım da mümkün hale geldi. Google’ın sunduğu bu kaynaklar çok değerli. Zekadan ödün vermeden model boyutunu küçültmek için ideal bir çözüm sunuyor.

Bu çözüm, herhangi bir eğitim sürecine ihtiyaç duymuyor. Bu özellik, geliştiriciler ve işletmeler için büyük bir kolaylık sağlıyor. TurboQuant, yapay zeka modellerinin daha erişilebilir olmasını sağlıyor. Aynı zamanda daha verimli çalışmalarına olanak tanıyor. Google’ın yapay zeka alanındaki araştırmalarını daha yakından incelemek için Google AI Research sayfasını ziyaret edebilirsiniz. Bu gelişmeler, yapay zekanın geleceğini şekillendiriyor.

Daha fazla güncel Yapay Zeka haberleri için sitemizi ziyaret edebilirsiniz.