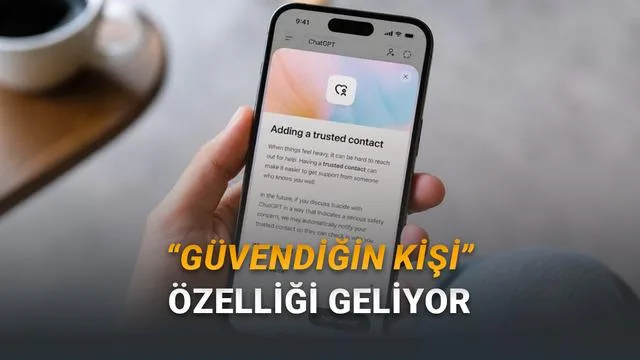

ChatGPT intihar önleme konusunda önemli bir adım atarak, yeni ‘Güvendiğin Kişi’ özelliğini duyurdu. Bu inovatif işlev sayesinde, yapay zeka sohbet botu tehlikeli bir durumda olduğu düşünülen kullanıcıların yakınlarına bildirim gönderebilecek. OpenAI tarafından geliştirilen bu sistem, dijital ortamda ruh sağlığına yönelik potansiyel riskleri azaltmayı hedefliyor. Özellikle kendine zarar verme veya intihar düşüncesi taşıyan bireyler için ek bir güvenlik katmanı oluşturuluyor.

ChatGPT’nin Yeni Güvenlik Adımı: İntihar Önleme Sistemi

OpenAI’ın geliştirdiği bu özellik, kullanıcıların ruh sağlığını ön planda tutmayı amaçlıyor. Yapay zeka, bir kullanıcının kendine zarar verme veya intihar gibi hassas konular hakkında ciddi bir şekilde konuştuğunu tespit ettiğinde devreye giriyor. Sistem, önceden belirlenen ‘Güvendiğin Kişi’ye bildirim gönderilmesini sağlıyor. Bu sayede, potansiyel bir krize karşı erken müdahale imkanı sunuluyor.

Bu yeni güvenlik protokolü, tamamen isteğe bağlı bir mekanizma olarak çalışacak. Kullanıcılar, isterlerse bu özelliği kendi hesaplarında aktif edebilecekler. 18 yaş ve üzeri tüm ChatGPT kullanıcıları bu imkandan faydalanabilecek. Hesap ayarları üzerinden bir arkadaş, aile üyesi veya bakım veren kişi ‘Güvendiğin Kişi’ olarak eklenebiliyor. Eklenen kişinin, bu daveti bir hafta içinde kabul etmesi gerekiyor. Bu süre içinde onaylanmayan davetler otomatik olarak iptal oluyor.

Kullanıcılar diledikleri zaman ekledikleri kişiyi değiştirebilir veya listeden tamamen kaldırabilirler. Aynı şekilde ‘Güvendiğin Kişi’ olarak eklenen kişi de kendi isteğiyle bu görevden ayrılabiliyor. Bu esneklik, kullanıcıların kişisel tercihlerine saygı duyulduğunu gösteriyor. Sistem, kullanıcıların kontrolünü her aşamada elde tutmasını sağlıyor.

Gizlilik Endişeleri ve OpenAI’ın Yaklaşımı

OpenAI, gönderilecek bildirimlerin gizliliği konusunda önemli güvenceler veriyor. Şirket, kullanıcıların sohbet kayıtlarını veya mesaj içeriklerini yakınlarına asla göndermeyeceğini belirtiyor. Sistem, yalnızca ciddi bir güvenlik riski algıladığında devreye giriyor. Bu durumda dahi, sadece kısa ve genel bir uyarı iletilerek, mahremiyetin korunması hedefleniyor.

Bildirim süreci ise belirli adımlarla ilerliyor. İlk olarak ChatGPT, potansiyel bir risk taşıyan konuşmayı tespit ediyor. Ardından kullanıcıya, güvendiği kişiyle iletişime geçmesi tavsiye ediliyor. Gerekirse bu kişiye bildirim gönderilebileceği açıkça ifade ediliyor. Kullanıcının onayı, bu süreçteki kritik noktalardan birini oluşturuyor.

Kullanıcı onayı alındıktan sonra, OpenAI’ın özel eğitimli küçük bir ekibi durumu inceliyor. Bu ekip, algoritmaların tespit ettiği durumu insan faktörüyle değerlendiriyor. Eğer gerçekten ciddi bir risk olduğu kanaatine varılırsa, bildirim süreci başlatılıyor. Güvenilir kişiye kısa bir e-posta, SMS veya uygulama içi bildirim gönderiliyor. Bu katmanlı denetim, yanlış bildirim riskini minimize etmeyi amaçlıyor.

Bu tür durumlarla karşılaşan veya ruhsal destek arayan kişiler için profesyonel yardım almak hayati önem taşır. Konuyla ilgili güvenilir bilgi ve destek için Türk Psikiyatri Derneği gibi otorite kaynaklara başvurulabilir. Yapay zeka teknolojileri, bu hassas konularda ek bir destek katmanı sunarak farkındalığı artırıyor.

Yapay Zeka Destekli Ruh Sağlığı Çözümleri

Yapay zeka teknolojileri, hayatımızın birçok alanında köklü değişiklikler yaratıyor. Akıllı asistanlar ve gelişmiş sohbet botları, günlük etkileşimlerimizin ayrılmaz bir parçası haline geldi. Bu durum, yapay zekanın ruh sağlığı alanındaki potansiyel rolünü de gündeme getiriyor. Özellikle kriz anlarında bireylere ulaşmak için yeni yollar sunulabiliyor.

ChatGPT’nin bu yeni özelliği, teknolojinin insanlık yararına nasıl kullanılabileceğine dair önemli bir örnek teşkil ediyor. Ancak bu tür sistemlerin doğru, hassas ve etik bir şekilde kullanılması büyük önem taşıyor. Yapay zeka güvenliği ve AI etik kuralları üzerine küresel tartışmalar yoğun bir şekilde devam ediyor. OpenAI gibi öncü şirketler, bu konularda proaktif adımlar atmaya çalışıyor.

Ruh sağlığı hizmeti sunan platformlar, yapay zekadan faydalanma yollarını araştırıyor. Erken müdahale, birçok durumda hayat kurtarıcı bir rol oynayabiliyor. ChatGPT’nin bu adımı, dijital ortamda yalnız hisseden veya zor durumda olan kişilere umut vadediyor. Ancak hiçbir yapay zeka sistemi, profesyonel bir terapistin veya uzmanın yerini tutamaz. Bu özellik, yalnızca mevcut destek sistemlerine ek bir katman olarak düşünülmelidir.

Yapay zekanın hızla gelişmesiyle birlikte, yeni güvenlik ve etik protokollere ihtiyaç duyuluyor. Bu tür sistemler, kullanıcıların dijital deneyimlerini daha güvenli hale getirme potansiyeline sahip. Özellikle hassas konularda, teknoloji insana destek ve yardım eli uzatabilir. Güvenli internet kullanımı ve dijital etik, günümüzde her zamankinden daha önemli hale geliyor. OpenAI’ın bu girişimi, yapay zeka sektöründeki diğer aktörlere de örnek teşkil edebilir.

Kimbiliyo Analizi: Bu Ne Anlama Geliyor?

ChatGPT’nin “Güvendiğin Kişi” özelliğini devreye alması, yapay zeka etiği ve insan gözetimi tartışmalarında yeni bir dönüm noktası oluşturuyor. Yüzeysel bir bakış açısıyla bu, intihar önleme gibi kritik bir alanda atılmış son derece insancıl ve teknolojik bir ilerleme gibi görünüyor. Yapay zekanın en hassas anlarda dahi bir cankurtaran görevi üstlenmesi fikri, toplumda geniş bir kabul görebilir ve umut vaat edebilir. Ancak bu özelliğin perde arkasında, derinlemesine incelenmesi gereken potansiyel riskler ve etik açmazlar da barındırıyor. Birincisi, yapay zekanın bir kullanıcının intihar riski taşıdığına “karar verme” süreci ne kadar şeffaf ve güvenilirdir? Algoritmanın yanlış bir pozitif tespit yapması, hem kullanıcı için ciddi ve gereksiz bir paniğe yol açabilir hem de ‘güvendiği kişi’ ile arasındaki özel ilişkinin zedelenmesine neden olabilir. Bu durum, bireylerin yapay zekayla olan samimiyetini sorgulatır.

İkincisi, gizlilik ve veri güvenliği endişeleri kaçınılmaz olarak yükseliyor. OpenAI, sohbet kayıtlarının paylaşılmayacağını özellikle vurgulasa da, “ciddi güvenlik riski” kavramını neye göre tanımladığı ve bu tür hassas kişisel verilerin arka planda nasıl işlendiği tam bir muamma teşkil ediyor. Bu belirsizlik, kullanıcılarda sürekli izlendiği ve yargılandığı hissini uyandırabilir, bu da onların yapay zekayla olan açık ve dürüst paylaşımlarını kısıtlayabilir. Zira bir yapay zekanın kendisini yargılayıp “tehlikeli” olarak etiketlemesi düşüncesi, birçok kullanıcı için rahatsız edici bir deneyim olacaktır. Gelecekte bu tür özelliklerin yaygınlaşmasıyla birlikte, teknolojinin insan ilişkileri ve özgür irade üzerindeki potansiyel etkisi daha da belirginleşecek. Yapay zeka, insanların en derin ve özel sorunlarına çözüm sunma potansiyeli taşırken, aynı zamanda gözetim ve müdahale algısını da beraberinde getiriyor. Bu durum, dijitalleşen dünyada bireylerin mahremiyet ve otonomi haklarını nasıl koruyacağımız sorusunu her zamankinden daha acil hale getiriyor. OpenAI gibi sektör liderlerinin bu tür hassas özelliklerde daha şeffaf olması, karar mekanizmalarını açıkça belirtmesi ve potansiyel yanlış anlaşılmaları gidermesi büyük önem taşıyor. Aksi takdirde, iyi niyetle atılan bu adımlar, kullanıcılar üzerinde beklenmedik psikolojik ve sosyal baskılar yaratabilir. Bu özellik, yapay zeka ve insan arasındaki karmaşık ilişkinin henüz başlangıç aşamasında olduğumuzu bir kez daha çarpıcı bir şekilde kanıtlıyor.

Daha fazla güncel Yapay Zeka haberleri için sitemizi takip edebilirsiniz.