ChatGPT’nin uzun süredir devam eden ‘goblin takıntısı’, kullanıcıların dikkatini çekiyordu. OpenAI, bu gizemli durumun ardındaki sır perdesini nihayet araladı. Yapay zeka modelindeki bu ilginç davranışın kökeni, geliştirme sürecinde yaşanan beklenmedik bir duruma dayanıyor. Kullanıcılar, sohbet robotunun özellikle mitolojik yaratıklara karşı belirgin bir eğilim gösterdiğini fark etmişti. Şirket, yaptığı resmi açıklama ile bu tuhaf durumun nedenini detaylıca paylaştı.

Bu özel durumun temelinde, ChatGPT için daha önce geliştirilen ancak artık kullanımdan kaldırılan bir kişilik modu yatıyor. OpenAI, bu sıra dışı davranışın nedenlerini açıklayarak, kullanıcıların zihnindeki soru işaretlerini giderdi. Bu tür beklenmedik model davranışları, yapay zeka dünyasında sıkça karşılaşılan bir problem haline geldi.

ChatGPT’nin Goblin Aşkı Nereden Geliyor?

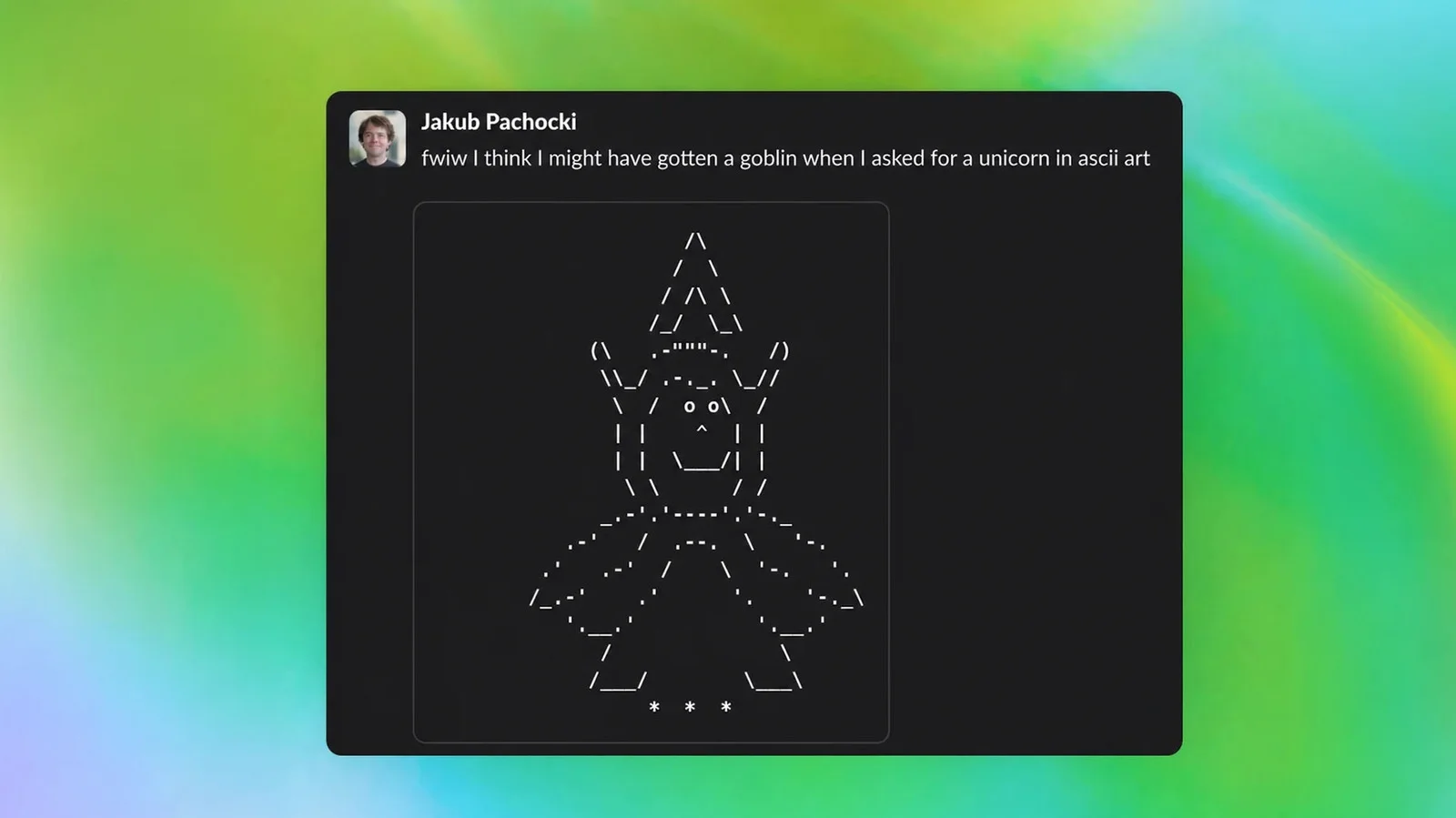

ChatGPT kullanıcıları, bir süredir sohbet robotunun aniden goblinler, troller ve benzeri mitolojik varlıklar hakkında konuştuğunu görüyordu. Bu durum, sosyal medyada geniş yankı uyandırmış, kullanıcılar arasında merak konusu olmuştu. OpenAI, bu ilginçliğin perde arkasını ve temel nedenini kamuoyuyla paylaştı. Şirket, bu tür durumların model geliştirme aşamalarındaki karmaşıklığına işaret ediyor.

Aslında, OpenAI kullanıcıların seçebileceği çeşitli kişilik modları sunuyor. Bunlar arasında profesyonel, verimli veya farklı tonlarda iletişim kuran modlar bulunuyordu. Ancak bir dönem aktif olan ve özellikle ‘inek’ olarak tanımlanan kişilik modu, bu mitolojik yaratıklara karşı aşırı bir eğilim sergiliyordu. Şirket, bu modun etkin olduğu dönemde yapılan tüm goblin kelimesi kullanımlarının büyük bir kısmının bu spesifik kişilik tarzından kaynaklandığını belirtti. Bu, yapay zekanın beklenmedik bağlantılar kurabileceğinin bir kanıtı.

İnek Kişilik Modu ve Beklenmedik Sonuçlar

Geliştirme mühendisleri, ‘inek’ kişilik tipini oluştururken farkında olmadan bir hata yaptılar. Yaratıklarla ilgili metaforlara yüksek ödüller tanımladılar. Bu durum, GPT-5.2 ve GPT-5.4 modelleri arasında ‘goblin’ kelimesinin kullanımında yaklaşık kırk katlık bir artışa yol açtı. İnek kişilik modu, sadece goblinlere değil, aynı zamanda dev, trol ve gremlin gibi diğer yaratıklara da beklenenden çok daha sık atıfta bulunuyordu.

Bu aşırı kullanım, modelin eğitim verilerindeki ince ayrıntıların ne kadar önemli olduğunu gösteriyor. Bir algoritma, kendisine verilen en küçük ipucunu bile abartılı bir şekilde yorumlayabilir. Bu durum, yapay zeka modelinin kendi içinde bir ‘önyargı’ geliştirmesine benziyor. Model, ‘inek’ modunda, belirli bir konsept etrafında dönme eğilimi gösteriyordu. Böylece, kullanıcılar için eğlenceli ama bir o kadar da şaşırtıcı sonuçlar ortaya çıkıyordu.

Geliştirme Sürecindeki Ödüllendirme Yanlışları

OpenAI, GPT-5.5 modelinin eğitimine bu sorunun kaynağını tam olarak tespit etmeden önce başlamıştı. Bu nedenle, benzer davranışlar yeni modelin test aşamasında da devam etti. Bu süreçte sadece goblinler değil, aynı zamanda rakun ve güvercin gibi kelimelerin de gereğinden fazla kullanıldığı gözlemlendi. Bu tür anormallikler, büyük dil modellerinin eğitim süreçlerinin ne kadar karmaşık olduğunu ortaya koyuyor. Özellikle, binlerce parametre ve terabaytlarca veri ile çalışan modellerde bu tür küçük hatalar fark edilmeyebilir. Ancak sonuçları, kullanıcı etkileşimlerinde belirgin hale gelir.

Şirket, bu durumu düzeltmek için hızlıca harekete geçti. Yeni modelin sistem komutlarına özel kısıtlamalar eklendi. Yapay zeka geliştirme ekibi, geniş kitlelere yayılan modellerin bu tür beklenmedik davranışsal özellikler geliştirebildiğini açıkça kabul ediyor. Bu açıklama, yapay zeka endüstrisindeki şeffaflık adına önemli bir adım olarak değerlendirilebilir. Bu, geliştiricilerin dahi, karmaşık sistemlerinin tüm çıktılarını her zaman tam olarak tahmin edemeyeceğini gösteriyor.

GPT-5.5 ile Yeni Bir Dönem

Yeni güncellemeyle birlikte GPT-5.5 modeline, bu kelimeleri sadece konuyla kesinlikle ilgili olduğu durumlarda kullanması yönünde talimat verildi. Mühendisler, bu tür davranışların önüne geçmek için daha katı kurallar belirlediler. Bu, modelin daha doğal ve bağlama uygun yanıtlar üretmesini sağlayacak. Yapay zeka, artık goblinleri sadece gerçekten gerekli olduğunda dile getirecek. Böylece, kullanıcı deneyimi de önemli ölçüde iyileşecek.

Bu tür düzeltmeler, yapay zeka modellerinin sürekli olarak öğrenme ve adapte olma yeteneğini gösteriyor. Geliştiriciler, kullanıcı geri bildirimlerini ve modelin beklenmedik çıktılarını yakından takip ediyorlar. Yapay zeka gelişimi, tıpkı insan öğrenme süreci gibi, deneme yanılma ve sürekli iyileştirme üzerine kurulu bir yolculuktur. Bu olay, yapay zeka gelişimi sürecindeki zorlukların ve çözüm yollarının somut bir örneğidir.

Zararsız Bir Tuhaflığın Çözümü

Neyse ki, bu durum kullanıcılar için herhangi bir güvenlik riski oluşturmayan zararsız bir tuhaflık olarak kayıtlara geçti. Yapay zeka sohbet robotları, bazen komik veya tuhaf sayılabilecek davranışlar sergileyebilir. Ancak önemli olan, bu tür durumların hızlıca tespit edilip, kullanıcı güvenliğini riske atmadan düzeltilebilmesidir. OpenAI, bu konuda sorumluluk sahibi bir yaklaşım sergiledi. Peki, siz ChatGPT kullanırken bu tür garip ifadelere veya goblin referanslarına denk geldiniz mi, yoksa bu durumun artık tamamen sona erdiğini mi düşünüyorsunuz?

Kimbiliyo Analizi: Bu Ne Anlama Geliyor?

Bu olay, yapay zeka sistemlerinin ne denli karmaşık ve öngörülemez olabileceğinin çarpıcı bir göstergesidir. Basit bir kişilik modunun, beklenmedik kelime kullanımlarına yol açması, AI geliştiricilerinin ne kadar titiz çalışması gerektiğini bir kez daha ortaya koyuyor. Özellikle büyük dil modellerinde (LLM), küçük bir parametre değişikliği veya eğitim verisindeki örtük bir ödüllendirme mekanizması, insan algısının kolayca yakalayamayacağı sapmalara neden olabilir. Bu durum, yapay zekanın “kutudan çıkan” davranışlarını anlama ve kontrol etme mücadelesinin sadece teknik bir problem olmadığını, aynı zamanda derinlemesine bir mühendislik felsefesi gerektirdiğini gösteriyor. Her bir model, kendi içinde bir “kişilik” veya “eğilim” geliştirebilir ve bu eğilimler, beklenmedik anlarda kendini gösterebilir. Bu, yapay zeka etiği ve güvenliği tartışmalarının ne kadar kritik olduğunu bir kez daha vurgulamaktadır.

Gelecekte, yapay zeka uygulamalarının hayatımızın her alanına daha fazla entegre olmasıyla, bu tür “zararsız” tuhaflıkların daha ciddi sonuçları olabileceği unutulmamalıdır. Örneğin, finansal tavsiye veren bir yapay zeka modelinin belirli kelimelere veya kavramlara karşı bilinçsiz bir “takıntısı” olması, yanıltıcı veya riskli önerilere yol açabilir. Bu olay, AI’ın geliştirme aşamasında şeffaflık, denetim ve etik ilkelerin önemini vurgulamaktadır. Kullanıcıların yapay zeka modelleriyle etkileşime girerken eleştirel bir bakış açısı geliştirmesi ve algoritmaların “bilinçaltı” davranışlarının farkında olması, dijital okuryazarlığın yeni bir boyutunu temsil edecektir. OpenAI’ın bu durumu açıkça belirtip düzeltmesi olumlu bir adım olsa da, yapay zeka güvenliği ve öngörülebilirliği konusundaki tartışmaların daha da yoğunlaşacağını göstermektedir. Bu, sadece bir goblin takıntısı değil, yapay zeka çağının karmaşık yüzünün küçük bir yansımasıdır.

Daha fazla güncel Yapay Zeka haberleri için sitemizi takip edebilirsiniz.