Meta’nın eski haber yöneticisi Campbell Brown, yapay zeka doğruluğunun gelecekteki önemine dikkat çekerek, bilgi akışının güvenilirliği konusunda ciddi endişelerini dile getiriyor. Kariyeri boyunca doğru bilginin peşinden koşan Brown, şimdi yapay zekanın bilgiyi tüketme şeklimizi nasıl değiştirdiğini gözlemliyor. Bu gidişatta tarihin tekerrür etme riskini görüyor ve sorunu çözmek için başkalarını beklememeye karar verdi.

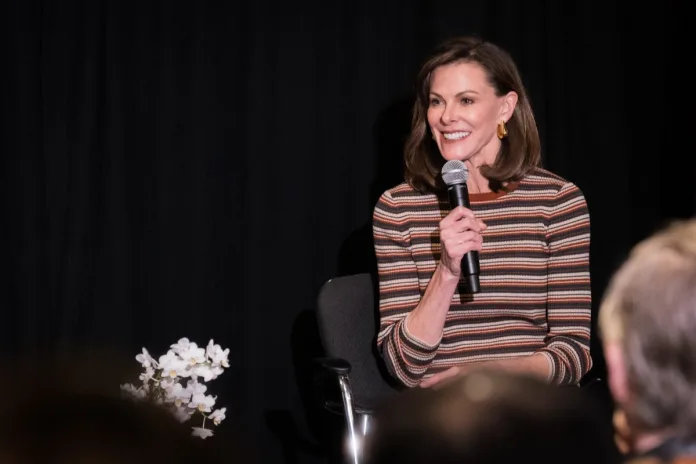

Brown, San Francisco’daki StrictlyVC etkinliğinde Forum AI adlı şirketini tanıttı. Bu şirket, ‘yüksek riskli konular’ olarak adlandırdığı alanlarda yapay zeka modellerinin performansını değerlendiriyor. Jeopolitik, ruh sağlığı, finans ve işe alım gibi konularda net evet-hayır cevapları olmadığını belirtiyor. Bu alanlar ‘bulanık, incelikli ve karmaşık’ bir yapıya sahip.

Forum AI: Uzmanların Rehberliğinde Doğruluk Denetimi

Forum AI’nin temel fikri, dünyanın önde gelen uzmanlarını bir araya getirmek. Bu uzmanlar, değerlendirme kriterlerini belirliyor ve daha sonra yapay zeka yargıçları modelleri geniş ölçekte değerlendirmek üzere eğitiliyor. Örneğin, jeopolitik çalışmaları için Brown, Niall Ferguson, Fareed Zakaria, eski Dışişleri Bakanı Tony Blinken gibi önemli isimleri ekibine dahil etti. Amaç, yapay zeka yargıçlarının insan uzmanlarla yaklaşık %90 oranında fikir birliğine ulaşmasını sağlamak. Brown, şirketinin bu eşiği yakaladığını belirtiyor.

Brown, 17 ay önce New York’ta kurulan Forum AI’nin ortaya çıkışını belirli bir ana dayandırıyor. ChatGPT’nin halka açıklandığı dönemde Meta’da çalıştığını anımsıyor. Kısa süre sonra, bu teknolojinin tüm bilgilerin aktığı ana kanal olacağını fark etti. Ancak bu kanalın ‘pek de iyi olmadığını’ gördü. Kendi çocukları için bu durum neredeyse varoluşsal bir hal aldı. ‘Eğer bu sorunu çözemezsek çocuklarım çok aptal olacak’ diye düşündüğünü dile getiriyor.

Yapay Zeka Modellerindeki Yanlılık ve Güvenilirlik Sorunları

Onu en çok hayal kırıklığına uğratan şey, doğruluğun kimsenin önceliği gibi görünmemesiydi. Temel model şirketlerinin ‘kodlama ve matematiğe aşırı odaklandığını’ belirtiyor. Haber ve bilgi konularının daha zor olduğunu kabul ediyor. Ancak zor olmasının, isteğe bağlı olduğu anlamına gelmediğini vurguluyor.

Forum AI önde gelen modelleri değerlendirmeye başladığında, bulgular pek de cesaret verici değildi. Brown, Gemini’nin Çin Komünist Partisi web sitelerinden alıntılar yaptığını örnek gösteriyor. Üstelik bu alıntıların Çin ile hiçbir ilgisi olmayan hikayelerde kullanıldığını belirtiyor. Ayrıca, neredeyse tüm modellerde sola eğilimli bir siyasi yanlılık tespit edildi. Daha ince hatalar da bolca mevcut olduğunu söylüyor. Bağlam eksikliği, farklı bakış açılarının göz ardı edilmesi ve argümanların yanlış yorumlanması gibi sorunlar bunlara dahil. ‘Daha gidilecek uzun bir yol var’ diyor. ‘Ancak sonuçları büyük ölçüde iyileştirecek bazı çok kolay düzeltmeler olduğunu da düşünüyorum.’

Brown, Facebook’ta yıllarca yanlış şeye optimize edildiğinde ne olduğunu gözlemledi. Tim Fernholz’a, ‘Denemelerimizin birçoğunda başarısız olduk’ dedi. Kurduğu doğruluk kontrol programı artık mevcut değil. Sosyal medyanın göz ardı etse de, etkileşimi optimize etmenin toplum için kötü olduğunu ve birçok kişiyi daha az bilgili bıraktığını belirtiyor.

Kurumsal Talepler Yapay Zekayı Doğruluğa Yöneltebilir mi?

Umut, yapay zekanın bu döngüyü kırabilmesidir. ‘Şu an iki yöne de gidebilir’ diyor. Şirketler kullanıcılara istediklerini verebilir veya ‘insanlara gerçek, dürüst ve doğru olanı’ sunabilir. Yapay zekanın gerçeği optimize etmesi fikrinin safça gelebileceğini kabul ediyor. Ancak burada kurumsal sektörün beklenmedik bir müttefik olabileceğini düşünüyor. Kredi kararları, borç verme, sigorta ve işe alım gibi konularda yapay zeka kullanan işletmelerin sorumluluğa önem verdiğini belirtiyor. Bu işletmelerin ‘doğru sonuçlar elde etmek için optimizasyon isteyeceğini’ öngörüyor.

Forum AI da iş modelini bu kurumsal talebe dayandırıyor. Ancak uyumla ilgili ilgiyi sürekli gelire dönüştürmek hâlâ bir zorluk. Özellikle de mevcut pazarın büyük bir kısmının, Brown’ın yetersiz bulduğu standart denetimler ve ölçütlerle yetiniyor olması bu durumu zorlaştırıyor. Brown, uyum düzenlemelerinin ‘bir şaka’ olduğunu ifade ediyor. New York’ta yapay zeka denetimi gerektiren ilk işe alım yanlılık yasası çıktığında, eyalet denetçisi ihlallerin yarısından fazlasının tespit edilmediğini buldu. Gerçek değerlendirmenin, sadece bilinen senaryoları değil, ‘insanların düşünmediği, başınızı belaya sokabilecek’ uç durumları da çözmek için alan uzmanlığı gerektirdiğini belirtiyor. Ve bu tür bir çalışmanın zaman aldığını ekliyor. ‘Zeki genelciler bu iş için yeterli olmayacak.’

Geçtiğimiz sonbaharda Lerer Hippeau liderliğinde 3 milyon dolar yatırım alan Brown’ın şirketi, yapay zeka endüstrisinin kendi imajı ile çoğu kullanıcının karşılaştığı gerçeklik arasındaki kopukluğu benzersiz bir şekilde açıklıyor. Büyük teknoloji şirketlerinin liderlerinden ‘bu teknoloji dünyayı değiştirecek’, ‘sizi işsiz bırakacak’, ‘kanseri iyileştirecek’ gibi iddialar duyulduğunu belirtiyor. Ancak sıradan bir kullanıcı bir sohbet robotuna basit sorular sorduğunda ‘hâlâ bir sürü saçmalık ve yanlış cevap’ aldığını dile getiriyor.

Yapay zekaya olan güven son derece düşük seviyelerde. Brown, bu şüpheciliğin çoğu durumda haklı olduğunu düşünüyor. ‘Silikon Vadisi’nde bir konu etrafında bir konuşma dönerken, tüketiciler arasında tamamen farklı bir konuşma yaşanıyor’ diyor. Daha fazla bilgi için yapay zeka etiği konusundaki yayınları inceleyebilirsiniz.

Kimbiliyo Analizi: Bu Ne Anlama Geliyor?

Campbell Brown’ın Forum AI girişimi, yapay zeka çağında bilginin güvenilirliği ve doğruluğu konusundaki derin endişelerin somut bir yansımasıdır. Haber sektöründen gelen birinin, yapay zeka modellerinin içeriği nasıl işlediği ve kullanıcıya sunduğu ‘gerçeklik’ üzerindeki potansiyel çarpıtmaları ele alması kritik bir öneme sahiptir. Meta’nın geçmişteki dezenformasyon sorunlarıyla mücadele deneyiminden ders çıkaran Brown, bu kez önleyici bir rol üstleniyor gibi görünüyor. Zira sosyal medyanın ‘etkileşimi’ önceliklendirmesi, toplumda bilgi kirliliğine ve yanlış anlaşılmalara yol açtı. Şimdi ise yapay zekanın daha da merkezi bir bilgi kanalı haline gelmesiyle, bu riskler katlanarak artma potansiyeli taşıyor. Yapay zeka liderlerinin ‘dünyayı değiştirecek’ vaatlerinin, sıradan kullanıcının aldığı ‘saçma ve yanlış’ cevaplarla çelişmesi, sektörün acil olarak öz eleştiri yapması gerektiğini gösteriyor. Bu uçurum, yapay zeka teknolojilerine olan güveni kökten sarsmaktadır.

Gelecekte, yapay zeka doğruluk mekanizmalarının sadece etik bir zorunluluk değil, aynı zamanda kurumsal itibar ve yasal sorumluluk açısından da vazgeçilmez bir gereklilik haline geleceği açıktır. Brown’ın ‘kurumsal talepler’ üzerinden umut beslemesi rasyoneldir; zira bankacılık, sigortacılık veya işe alım gibi alanlarda yanlış yapay zeka kararları, şirketler için devasa maliyetlere ve davalara yol açabilir. Ancak mevcut denetimlerin ‘şaka’ olarak nitelendirilmesi, bu alandaki regülasyonların ne denli yetersiz olduğunu ortaya koyuyor. Yapay zekanın toplumsal dokuya entegrasyonu hızlandıkça, yalnızca teknik değil, aynı zamanda felsefi ve etik açılardan da derinlemesine bir uzmanlık gerektiren kapsamlı denetim mekanizmalarının geliştirilmesi kaçınılmaz olacaktır. Aksi takdirde, yapay zeka, vaat edilen potansiyelini gerçekleştirmek yerine, bir dezenformasyon ve yanlılık motoruna dönüşebilir ki bu, insanlık için ciddi bir geri adım olur.

Daha fazla güncel Yapay Zeka haberleri için sitemizi takip edebilirsiniz.